wtsds

Mil pontos, LOL!

- Mensagens

- 20.634

- Reações

- 20.591

- Pontos

- 1.344

Logo chega nas GPUs você compra um Asus Rog mais só um fan funciona, as outras duas via pagamento de upgrade.

Vira essa boca pra la!

Registre uma conta gratuita hoje para se tornar um membro! Uma vez conectado, você poderá participar neste site adicionando seus próprios tópicos e postagens, além de se conectar com outros membros por meio de sua própria caixa de entrada privada!

Logo chega nas GPUs você compra um Asus Rog mais só um fan funciona, as outras duas via pagamento de upgrade.

A princípio, é exclusivamente para recursos específicos e série Xeon só. Mas é aquilo, certamente é brecha caso funcione bem.Acredito que isso aí é mais pra cliente corporativo mesmo, que precisa de recursos específicos.

Se, por exemplo, baixar o preço dos processadores "base" e não tirar recursos fundamentais, não acho que seja um problema grande.

O problema é a brecha pra se tornar um negócio zoado depois.

A AMD tem o mesmo, se chama PSB.

Ao meu ver isso é para o mercado de servidores e está mais voltado para recursos específicos.

Vamos supor que por padrão, uma CPU suporte uns 128 GB de RAM. Com um patch específico, a Intel pode fazer com que a CPU suporte mais memória. Outro exemplo seria capacidade de virtualização, poderia suportar mais máquinas virtuais ou melhor gerenciamento, enfim.

São recursos de software que nem todo mundo precisa e quando precisava, as vezes era necessário trocar a CPU inteira (e aí mora a possibilidade de ir pro concorrente). Com esse tipo de recurso, eles conseguem oferecer uma experiência customizada.

Como estão aplicando o patch no kernel do Linux, fica óbvio que o alvo são servidores e sendo Linux é mais fácil de gerenciar.

Para o mercado normal, é bem provável que isso não aconteça, porque não tem apelo comercial.

A gente tava falando outro dia dos 12100F e pessoal insistiu na coisa dos núcleos.

Isso é claramente uma certa fantasia, devido a baixa diferença (apenas 2 núcleos e 4 threads a menos). Só acompanhar o uso de CPU e mesmo produzindo mais frames, os 12100F muitas vezes tinham o mesmo uso de um Ryzen 3600. 5% a mais de workload no geral. Muito pouco pra justificar essa história de preferência por núcleos. Ao menos nesse caso.

Detalhe pro 1% sempre - as vezes bem - superior também ao Ryzen 3600. E, tipo, uma 3090 foi testada. 3090. Uma RTX3050 faria metade desses frames +-. Logo a carga de trabalho de CPU seria muito menor também.

Matador demais. 12100F e RTX3050 é o novo "baratinho" quando as placas H610 baixarem de preço rsrs. (ironia contida)

A gente tava falando outro dia dos 12100F e pessoal insistiu na coisa dos núcleos.

Isso é claramente uma certa fantasia, devido a baixa diferença (apenas 2 núcleos e 4 threads a menos). Só acompanhar o uso de CPU e mesmo produzindo mais frames, os 12100F muitas vezes tinham o mesmo uso de um Ryzen 3600. 5% a mais de workload no geral. Muito pouco pra justificar essa história de preferência por núcleos. Ao menos nesse caso.

Detalhe pro 1% sempre - as vezes bem - superior também ao Ryzen 3600. E, tipo, uma 3090 foi testada. 3090. Uma RTX3050 faria metade desses frames +-. Logo a carga de trabalho de CPU seria muito menor também.

Matador demais. 12100F e RTX3050 é o novo "baratinho" quando as placas H610 baixarem de preço rsrs. (ironia contida)

Repara que ele bate 90% quando tem que fazer 100FPS num AAA. Ninguém compra um CPU desse pra fazer 100FPS. Também ng compra pra fazer par a uma 3090, que faz até mais de 100FPS mesmo num jogo de altíssima demanda de carga de trabalho feito esse. Tu vai colocar essa CPU com uma placa de vídeo que nesse jogo vai pegar uns 60~75FPS no máximo. Ai já reduz o workload tranquilo pra uns 70%~75% em pico. Nessa condição, o 12100F vai deitar e rolar de boa por muito tempo.No cyberpunk ele bate 92% de uso as vezes! Será q 8T segura a geração toda? Sei não! Jogos de mundo aberto da nova geração pode ser q 12t seja o ideal!

Ele bate 92% porque ele tá com uma 3090. Ele vai segurar a geração de boa se colocar ele numa placa de vídeo que esteja a altura de um CPU de 1k, saca? Pq uma 3050 faria menos da metade dos frames ali, logo o uso cairia pra uns 60%~65%, chuto.

Quero ver o teste do cara fazendo STREAM e gravando isso daí ao mesmo tempo.

Testar só o jogo é facil, quero ver forçar o uso exigindo mais nucleos para outras coisas.

Certeza que quem tem mais nucleos se dará melhor que esse 12100.

100FPS num Cyberpunk é pouco? 0o EitaMas não está fazendo tantos fps não. Com uma 3050 faria menos e usaria menos claro. Ainda acho q 8T não segura os jogos de mundo aberto q vão sair só pros consoles novos!

Até mesmo para um streamer, se ele equilibrar e colocar um 12100F ao lado de uma placa nível RTX3060 no máximo, a carga de trabalho no jogo vai reduzir uns 20% ou mais devido ao fato de produzir muito menos frames. Então até pra esse nicho, sabendo equilibrar o sistema, não terá problemas. Em especial o cara escolhendo uma nVidia, que praticamente faz o trabalho sozinha.

Sem falar que streamer é nicho demais pra se levar em conta na hora de uma opinião abrangente e genérica.

100FPS num Cyberpunk é pouco? 0o Eita

Eu acho que aquela conversa com o @Trezoitao38 foi bastante didática quanto a isso. E ele esclareceu bem legal algumas coisas pra gente, que estavam mesmo confusas.

Se vc trocar uma 3050 por uma 4060, por exemplo, teu objetivo vai ser manter a qualidade gráfica mais alta, não aumentar os frames. Não aumentando os frames, a carga de trabalho não vai mudar muito.

A gente nunca sabe mesmo. Eu não tô dizendo que o 12100F é futureproof. Quem quer isso aluga uma bola de cristal ou arrisca logo num i7/Ryzen 7, jamais num i3 rsrs. De certo aumenta as chances. Mas não deixa de pagar uma placa de vídeo melhor por causa disso. Ai acho furada.Eu achei q era 80 a 90 fps. Realmente se travar a 60fps acho q talvez seja possível! Mas o uso pode aumentar em física em jogos da nova geração!

A ordem de performance de placas pra Chipset Intel, da pior pra melhor é B<<H<<<Z?Na Pichau apareceu algumas placa-mãe com chipset B660. Preço variando entre R$ 1.099,89 (AsusEX-B660M-V5 D4) e R$2.521,22 (Asus ROG STRIX B660-F).

Mas cooler LGA 1700 ainda me parece raridade por aqui. Na maioria dos casos parece ser necessário comprar adaptador direto do fabricante. Embora as placas de Asus, em sua maioria, parece fazer gambiarra para suportar os cooler LGA 1200.

Não sei se é um problema generalizado, mas na Newegg vejo algumas reviews reclamando da placa de rede Intel presente nas Z690.

Edit: Também tem placa com chipset H610. Asus PRIME H610M-E D4 por R$ 883,19. Deve ser a placa mais barata e simples para LGA 1700. Só 4 USB na traseira. Para mim, eu começo a sentir falta se tiver só 6.

A ordem de performance de placas pra Chipset Intel, da pior pra melhor é B<<H<<<Z?

Sem orçamento definido? Pq tem enormes diferenças entre as CPUs e plataformas disponíveis.Povo, me ajude. Preciso de uma configuração relativa a CPU que dure uns 5 anos. Uso basicamente pra jogos em 1440p. Provavelmente futuro 4k. Então, o que indicariam (Intel ou AMD) de CPU, Mobo e memórias?

Na Pichau apareceu algumas placa-mãe com chipset B660. Preço variando entre R$ 1.099,89 (AsusEX-B660M-V5 D4) e R$2.521,22 (Asus ROG STRIX B660-F).

Mas cooler LGA 1700 ainda me parece raridade por aqui. Na maioria dos casos parece ser necessário comprar adaptador direto do fabricante. Embora as placas de Asus, em sua maioria, parece fazer gambiarra para suportar os cooler LGA 1200.

Não sei se é um problema generalizado, mas na Newegg vejo algumas reviews reclamando da placa de rede Intel presente nas Z690.

Edit: Também tem placa com chipset H610. Asus PRIME H610M-E D4 por R$ 883,19. Deve ser a placa mais barata e simples para LGA 1700. Só 4 USB na traseira. Para mim, eu começo a sentir falta se tiver só 6.

Problemas na placa de rede em placas de todas as fabricantes?

Povo, me ajude. Preciso de uma configuração relativa a CPU que dure uns 5 anos. Uso basicamente pra jogos em 1440p. Provavelmente futuro 4k. Então, o que indicariam (Intel ou AMD) de CPU, Mobo e memórias?

Povo, me ajude. Preciso de uma configuração relativa a CPU que dure uns 5 anos. Uso basicamente pra jogos em 1440p. Provavelmente futuro 4k. Então, o que indicariam (Intel ou AMD) de CPU, Mobo e memórias?

Montei um 12700FK com uma Gigabyte Z690 Gaming X DDR4. Tá quase tudo em stock aqui, exceto memórias que já deixei em XMP, são memórias 3000 mhz, não quis gastar muito aqui. E tou usando um Cooler Master ML240L V2 RGB de 240 mm. E olha, no testetizinho do CPU-Z, conseguiu aguentar aqui em 75-77 graus. Não é o teste mais pesado e pelo visto tá limitado a potência próximo de 125 watts, chegou a consumo de pouco mais de 130 watts. Mas tá bom, em jogos deve esquentar e consumir menos que isso. Eu ainda devo desligar os E-Cores, porque por enquanto não há necessidade deles. Clock ficou estável 4.7 ghz para os P-Cores e 3.6 ghz para E-Cores.

Alguma previsão de qdo vão sair os processadores sem o "k"?

Interessante o ganho de ipc na casa de 2 digitos, de uma série q é só refresh da outra! E a melhor capacidade de overclock, mesmo assim acho eu q o Zen 4 vai ficar um pouco acima dessa 13 geração da Intel, a não ser q a AMD tenha feito m****. Pq vi alguns canais com informações privilegiadas q falam q o ganho minimo do zen 3 pro 4 será na casa de 25%! Isso é um ganho absurdo!

Eles disseram melhoria de desempenho, não de IPC.

Passando de 8E pra 16E, o multicore dos E tem que dobrar mesmo. Aí aquele velho aumento de clock base/turbo e zás.

Ah se for o mesmo ipc pra min não vale m**** nenhuma. Até pq raros jogos tiram proveitos desses E-cores da vida! Só pra quem usa render q deve se beneficiar desses cores todos a mais. Eu achava q poderia ter mais P-cores nesses 13900k

bacana os seus testesTou sem internet e resolvi fazer um teste curioso. O que dá mais desempenho, e-cores ou os threads lógicos? Pro teste ficar simétrico, desliguei 4 p cores. Assim eu testei um 4/8 + 0 e cores e um 4/4 + 4 e cores.

Visualizar anexo 243856

Single: 731 Multi: 4007 Consumo: 92 watts

Bom, esse teste aí de certa forma vocês já viram, é basicamente um i7 transformado num i3. Porém com um clock maior. É o 4/8 sem E-Cores.

Visualizar anexo 243858

Single: 791 Multi: 4669 Consumo: 59 watts

Já este eu desabilitei o hyperthreading e liguei os 4 E-Cores.

Vejam o maior desempenho em single thread sem hyperthreading. Guardem isso porque tem algo curioso sobre essa performance single thread.

Testes do Cinebench R20 agora:

4/8 sem E-Cores:

Multi: 3830

Visualizar anexo 243861

Single: 729

Visualizar anexo 243862

4/4 Com E-cores:

Multi: 4176

Visualizar anexo 243863

Single: 720

Visualizar anexo 243864

Esses testes foram feitos com limite de 125 watts. O outro teste que aparece aí é em 65 watts 8/16 sem E-Cores.

O desempenho single não muda no Cinebench R20. Então porque no CPU-Z há essa mudança eu realmente não sei, alguma coisa relacionada na metodologia desses testes.

E a última pergunta, os 4 E-cores tem desempenho bom suficiente pra bater 8 threads lógicos? Chega perto, mas nesse caso é melhor rodar 8/16 para multhreading com certeza. Porém fica a dúvida para singlethread, pois pelo menos no CPU-Z teve desempenho melhor.

Agora vem aqui uma coisa que apareceu em alguns testes. Geração 12 da Intel perdendo no Counter Strike: Global Ofensive para os Ryzen. Mas e se desligassem o hyperthreading e refizessem os testes?

Outra coisa é que o 13900k será um 8/16 + 16/16. Eu acredito que nesse caso desligar E-cores não terá o mesmo efeito do 12900k. Pode ser que para o 13900k valerá mais a pena desligar o hyperthreading. Reparem também nos dados de consumo dos dois primeiros testes que postei aqui. Hyperthreading também faz consumir mais, tanto que consome mais energia que os E-Cores.

Lembram lá 10 anos atrás quando falavam que um i5 era melhor para jogos do que um i7? Não era mentira, pois se um jogo não conseguia utilizar mais do que 4 cores, o hyperthreading poderia atrapalhar na performance. Claro, o silício do i7 era melhor, então comprar um i7 e desligar pela bios o hyperthreading iria trazer resultados melhores do que o i5. Porém o custo maior do i7 fazia isso não valer a pena.

Com os Ryzen o comportamento deve ser diferente. O ponto que me intriga é porque testes assim não foram feitos em benchmarks. O 12900k sem hyperthreading, porém com os E-Cores, teria melhor resultado do que rodar ele 8/16 sem E-Cores? Isso são testes sintéticos e não levam em consideração a comunicação entre esses núcleos, mas sempre tive essa curiosidade.

Se tiver um game que seja bom testar CPU para vermos como isso funciona na prática e vocês puderem citar, talvez eu possa fazer o teste. Porém, no caso de um game a minha GTX 1080 pode gerar certos gargalos. Como comprei esse kit mais para emulação não me incomodo tanto com o gargalo da 1080 que não será sentido para esses casos.

Peço desculpas pelas imagens, elas foram reduzidas pelo fórum e acaba ficando praticamente impossível ver os resultados. Editei postando os resultados dos testes.

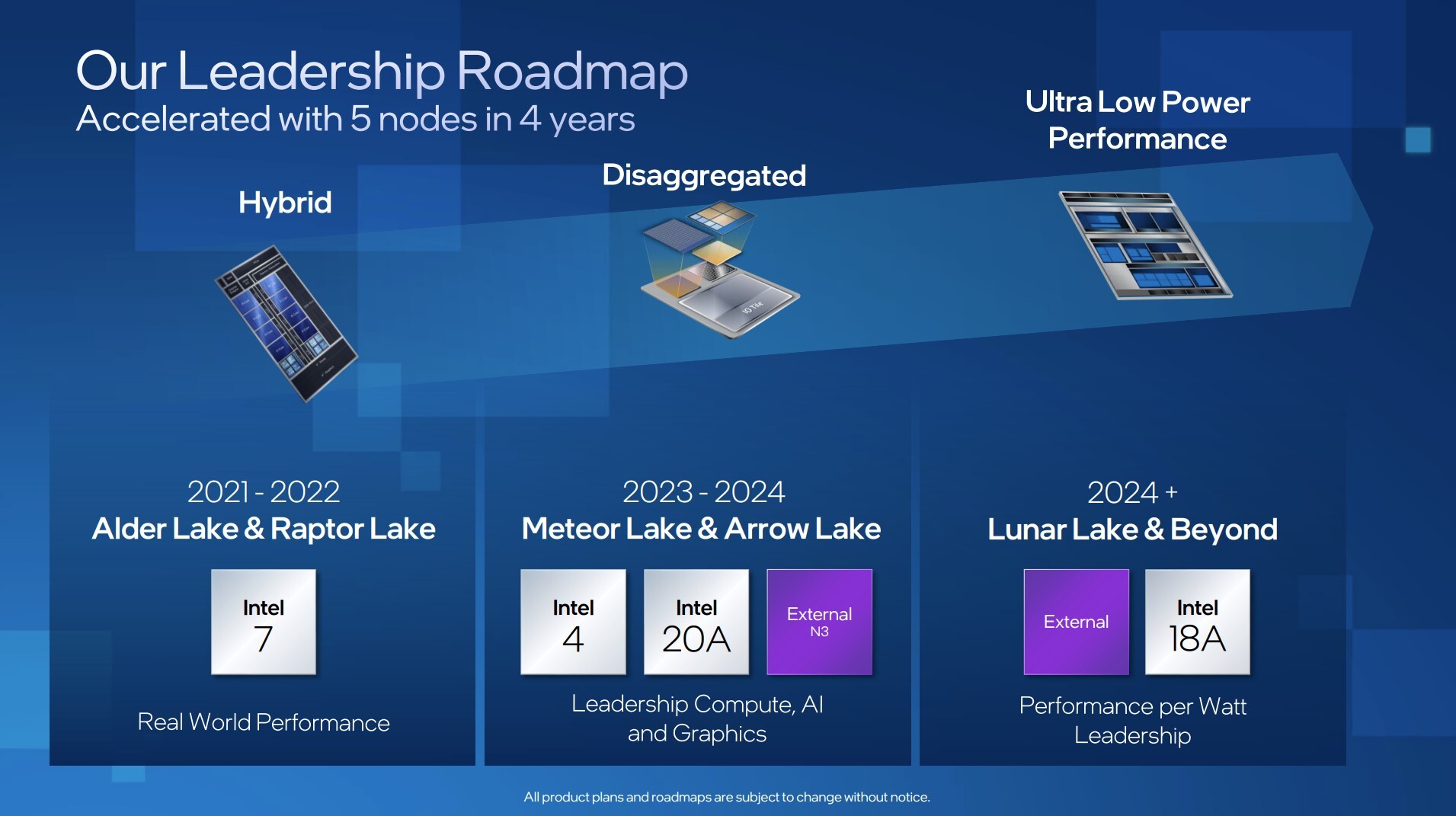

| VideoCardz | Alder Lake | Raptor Lake | Meteor Lake |

|---|---|---|---|

| Intel Mainstream Desktop CPU Roadmap (RUMORED) | |||

| Launch Date | Q4 2021 | Q4 2022 | Q2 2023 |

| Fabrication Node | Intel 7 | Intel 7 | Intel 4 |

| Big Core µArch | Golden Cove | Raptor Cove | Redwood Cove |

| Small Core µArch | Gracemont | Gracemont | Crestmont |

| Graphics µArch | Gen12.2 | Gen12.2 | Gen 12.7 |

| Max Core Count | 16 (8C+8c) | 24 (8C+16c) | TBC |

| Socket | LGA1700 | LGA1700 | TBC |

| Memory Support | DDR4/DDR5-4800 | DDR4/DDR5-5600 | DDR5 |

| PCIe Gen | PCIe 5.0 | PCIe 5.0 | PCIe 5.0 |

| Intel Core Series | 12th Gen Core | 13th Gen Core | 14th Gen Core |

Tou sem internet e resolvi fazer um teste curioso. O que dá mais desempenho, e-cores ou os threads lógicos? Pro teste ficar simétrico, desliguei 4 p cores. Assim eu testei um 4/8 + 0 e cores e um 4/4 + 4 e cores.

Visualizar anexo 243856

Single: 731 Multi: 4007 Consumo: 92 watts

Bom, esse teste aí de certa forma vocês já viram, é basicamente um i7 transformado num i3. Porém com um clock maior. É o 4/8 sem E-Cores.

Visualizar anexo 243858

Single: 791 Multi: 4669 Consumo: 59 watts

Já este eu desabilitei o hyperthreading e liguei os 4 E-Cores.

Vejam o maior desempenho em single thread sem hyperthreading. Guardem isso porque tem algo curioso sobre essa performance single thread.

Testes do Cinebench R20 agora:

4/8 sem E-Cores:

Multi: 3830

Visualizar anexo 243861

Single: 729

Visualizar anexo 243862

4/4 Com E-cores:

Multi: 4176

Visualizar anexo 243863

Single: 720

Visualizar anexo 243864

Esses testes foram feitos com limite de 125 watts. O outro teste que aparece aí é em 65 watts 8/16 sem E-Cores.

O desempenho single não muda no Cinebench R20. Então porque no CPU-Z há essa mudança eu realmente não sei, alguma coisa relacionada na metodologia desses testes.

E a última pergunta, os 4 E-cores tem desempenho bom suficiente pra bater 8 threads lógicos? Chega perto, mas nesse caso é melhor rodar 8/16 para multhreading com certeza. Porém fica a dúvida para singlethread, pois pelo menos no CPU-Z teve desempenho melhor.

Agora vem aqui uma coisa que apareceu em alguns testes. Geração 12 da Intel perdendo no Counter Strike: Global Ofensive para os Ryzen. Mas e se desligassem o hyperthreading e refizessem os testes?

Outra coisa é que o 13900k será um 8/16 + 16/16. Eu acredito que nesse caso desligar E-cores não terá o mesmo efeito do 12900k. Pode ser que para o 13900k valerá mais a pena desligar o hyperthreading. Reparem também nos dados de consumo dos dois primeiros testes que postei aqui. Hyperthreading também faz consumir mais, tanto que consome mais energia que os E-Cores.

Lembram lá 10 anos atrás quando falavam que um i5 era melhor para jogos do que um i7? Não era mentira, pois se um jogo não conseguia utilizar mais do que 4 cores, o hyperthreading poderia atrapalhar na performance. Claro, o silício do i7 era melhor, então comprar um i7 e desligar pela bios o hyperthreading iria trazer resultados melhores do que o i5. Porém o custo maior do i7 fazia isso não valer a pena.

Com os Ryzen o comportamento deve ser diferente. O ponto que me intriga é porque testes assim não foram feitos em benchmarks. O 12900k sem hyperthreading, porém com os E-Cores, teria melhor resultado do que rodar ele 8/16 sem E-Cores? Isso são testes sintéticos e não levam em consideração a comunicação entre esses núcleos, mas sempre tive essa curiosidade.

Se tiver um game que seja bom testar CPU para vermos como isso funciona na prática e vocês puderem citar, talvez eu possa fazer o teste. Porém, no caso de um game a minha GTX 1080 pode gerar certos gargalos. Como comprei esse kit mais para emulação não me incomodo tanto com o gargalo da 1080 que não será sentido para esses casos.

Peço desculpas pelas imagens, elas foram reduzidas pelo fórum e acaba ficando praticamente impossível ver os resultados. Editei postando os resultados dos testes.